(文/万肇生 编辑/张广凯)

5月16日,腾讯发布最新混元图像2.0模型,该模型号称改变传统"抽卡-等待-抽卡"的方式,在行业内率先实现实时生图,带来交互体验革新。

目前市面上的各类大模型中,除了非推理语言大模型的生成外,几乎所有模态大模型的生成过程,都或多或少需要经历等待。尤其在文生图领域,抽卡一样重复生成多个结果,严重影响效率。然而据腾讯介绍,该混元图像2.0就主打一个"快",支持文生图和绘画生图。且无论是输入文字指令、语音指令,或上传本地图、在线绘制图,"都能毫秒级获得高质感图像"。

根据演示案例显示,用户在输入"一位女士"时,模型首先生成了一张证件照。此时在输入框内继续输入"…风景照、沙漠中",画面的背景于是瞬间变成翠绿色,紧接着又秒变成沙漠黄。继续再输入"扎着头发、回眸一笑",画面也飞速切换,最终随着输入操作的结束,画面直接生成完毕。

在另一个生成"爱因斯坦在东方明珠前自拍"的案例中,该模型也非常迅速的展现出整个生成的过程。

除了文生图外,该模型还支持在图片上使用画笔修改的"实时绘画板",同样迅速可以生成结果。

通常情况下,绘画过程中的即时反馈可以让用户对作品迅速做出调整,但AI图像生成的修改往往是反复投喂产出。因此,如果在生成的过程中可以实时进行修改,效率则将极大提高。

腾讯表示,相比前代模型,该模型参数量提升了一个数量级,得益于超高压缩倍率的图像编解码器以及全新扩散架构,其生图速度显著快于行业领先模型。在同类商业产品每张图推理速度需要5到10秒的情况下,混元可实现毫秒级响应,支持用户可以一边打字或者一边说话一边出图。

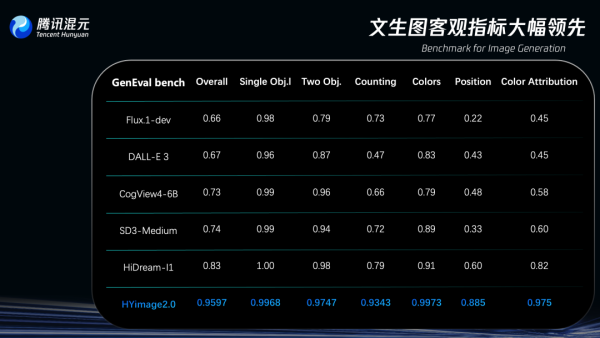

而在评分方面,腾讯称,混元图像2.0模型在图像生成领域专门测试模型复杂文本指令理解与生成能力的评估基准GenEval(Geneval Bench)上,准确率超过95%,远超其他同类模型。

目前,该模型的使用还需注册预约。